CES的深度折解,Nvidia新晶片的「六位一體」?進軍自動駕駛?不需要散熱了嗎? - KP思考筆記(第24期)

大家好,我是 KP,歡迎來到第 24 期的《週末思考筆記》。

2026 年的第二個星期,有兩件重要大事。

第一件,是關於我個人的小里程碑。早前曾跟大家提過,我收到了 AWS 的邀請,去分享我對這場 AI 競賽的看法。就在前幾天,這場分享會圓滿結束了。

老實說,作為一個出身金融業的人,和不同的人分析投資標的、拆解資本流向是我的老本行,我早已習以為常。

但要站在一群科技人才面前談科技趨勢,心裡確實有點「班門弄斧」的緊張感。不過,我一直對都十分關注科技業的發展,每當看到那些突破邊界的技術,我總會不由自主地幻想:未來的世界到底會變成什麼樣子?

這次能以「跨界者」的身分與科技圈產生連結,對我而言,是榮幸,更是激勵。

而第二件大事,則是正在拉斯維加斯如火如荼進行的 CES 2026 (消費電子展)。

如果你以為 CES 只是個看新電視、新手機的展覽,那可能低估了它的影響力。在科技圈,CES 是一月最重要的「定調之戰」。

原因很簡單,CES 發生在每年的一月,吸引了全球數以萬計的記者,所以各大科技巨頭會在此時發表當年的「年度主旋律」。

CES也是少數能讓「傳統製造業」與「半導體公司」以及「軟體公司」聚在一起的地方。

令到在展場華麗的燈光背後,有無數的「閉門會議」,不同公司,投資人等等坐在一起,商討有沒有合作空間。

因此,本週的《週末思考筆記》內容極其紮實。我整理了 8 個核心主題,其中 7 個都聚焦在 CES 2026 的深度拆解:

主題一:當機器人不再只是表演後空翻

主題二:Panther Lake 的準時赴約,Intel要強勢歸來?

主題三:「六位一體」的戰爭機器,拆解 NVIDIA Vera Rubin 的系統級宰制力

主題四:工業宇宙的作業系統,解析西門子與 NVIDIA 的聯盟

主題五:自動駕駛的「Android 時刻」,Alpamayo 究竟想如何挑戰 Tesla 和 Waymo?

主題六:Nvidia新架構不再需要散熱了嗎?

主題七:AMD打算如何追趕Nvidia?

主題八:當算力戰爭打到發電廠,xAI的「能源獨立」大計

(為新朋友快速說明:我的內容分為兩種:「深入研究」是付費會員專屬的重磅分析;「週末思考筆記」則是你正讀的這篇,是分享市場觀點的投資散文,永久免費。)

話不多說,我們直接進入正題!

進入正文之前會員們可以投下你們的神聖一票,決定兩星期後「深入研究」的主題。

投票將在 3天後 結束。

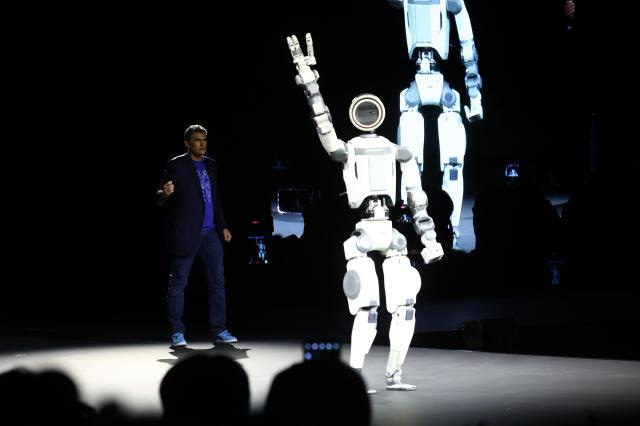

主題一:當機器人不再只是表演後空翻

如果過去十年的機器人產業是一場漫長的「概念演習」,那麼 CES 2026 就是正式的「實戰校閱」。

這次展會傳遞出一個極其強烈的信號:人形機器人已經從「研發預算」轉向了「資本支出(CAPEX)」。這不再是科技大佬們用來展示肌肉的公關工具,而是製造業巨頭們寫入財報、實打實的生產力工具。

告別「錄製」,迎來「直播」

過去我們看波士頓動力(Boston Dynamics)的影片,總是在驚嘆後空翻或跑酷,但那些大半是錄製好的程式。

在 CES 2026,波士頓動力選擇在展場現場遠端操控 Atlas。機器人公司很少在現場演示人形機器人,因為任何一次失誤都會引來災難性的關注。

這向市場傳達了一個訊息:Atlas 已經不再是實驗室裡的產品,它具備了進入工廠所需的「工業級穩定性」。只有當供應鏈、維護體系與成本結構都準備好時,一家公司才敢冒著「現場翻車」的風險進行公開展示。

VLA 模型:從「寫程式」到「教小孩」

真正賦予 Atlas「靈魂」的,是與 Google DeepMind Gemini AI 的深度整合,突破點是 VLA(Vision-Language-Action)模型 的成熟。

當你下達「拿起鍵盤旁邊的紅杯子」時,VLA 模型並非在執行一段死板的程式。它從網路規模的訓練中早已學會了什麼是「杯子」、理解「旁邊」這類空間關係、並將「紅色」與視覺特徵關聯起來。

它解決了困擾機器人學數十年的「泛化」(Generalization)難題,一個在藍色杯子上訓練過的機器人,現在能理解「藍色」是一個獨立於物體形狀的顏色屬性。

現在的機器人不需要針對特定任務重新訓練,它能聽懂自然語言指令並直接執行。這意味著機器人的部署成本將呈指數級下降,因為訓練週期大幅縮短。

機器人的群體進化

在 CES 2026 之前,每一台機器人都是一座孤島。1 號機器人學會了繞開障礙物,其餘 999 台對此一無所知。

今年,幾乎所有頭部玩家都推出了「聯邦學習」(Federated Learning)系統。這背後的邏輯是:一台機器人跌倒的教訓,會立刻變成一萬台機器人的經驗。當一台 Atlas 在現代汽車(Hyundai)的工廠裡遇到一個極端案例(Edge Case),解決方案會透過 OTA 瞬間同步給全球的機隊。

這種「群體智慧」的進化速度,是人類勞動力永遠無法企及的。

從藍圖到產線

如果說技術是前提,那麼資本和產能的承諾,則是拐點的最終確認。

現代汽車 + 波士頓動力: 現代在 CES 上宣布,到 2028 年實現每年生產 30,000 台 Atlas 的目標,並將其部署於喬治亞州的電動車超級工廠。

智元機器人(AgiBot): 如果說現代的承諾是「未來」,那麼智元的出貨量就是「現在」。該公司宣布已在全球製造並交付超過 5,000 台人形機器人。

宇樹科技(Unitree): 宇樹宣布 H2 型號將於 2026 年 4 月以 29,900 美元的價格開始出貨。

混合動力模式:為什麼「遠端操作」不是退步?

很多人看到機器人背後還有真人遠端操作,就覺得技術還不成熟,這話只對了一半。

事實上,「人機協作」是目前商業落地的最優解。一個熟練的工人可以同時監控並切換操作 10 台機器人,機器人處理 90% 的重複動作,人類處理 10% 的複雜決策。

投資回報率(ROI)算得過來: 一台機器人 3-5 萬美金,3-5 年回本。

數據閉環: 人類的每一次干預,都是在為 AI 提供最高質量的訓練數據。

這解釋了為什麼智元能在還沒實現「完全自主」前,就已經在全球交付了超過 5,000 台機器人。市場等不及完全自主,市場要的是現在就能省錢的方案。

全球棋局:美國的「大腦」與中國的「規模」

CES 2026 展現了清晰的競爭格局:

美歐陣營(波士頓動力、Figure、NEURA): 專注於 AI 大腦的深度整合與極致的工業安全標準。

中國陣營(宇樹、智元): 展現了強大的供應鏈整合與成本控制能力。宇樹H2 喊出 2.9 萬美金的明確售價與交期,這是在逼著全球製造業做選擇。

目前看來,中國廠商在商業化速度與成本優化上領先了 1-2 年。

拐點已至,但驗證尚需時日

雖然人形機器人已經跨過了商業門檻,但投資者需要區分:誰在賣「願景」(如家用機器人,目前仍屬科幻),誰在賣「工具」(如工業與物流機器人)。

CES 2026 證明了生產級硬體、推理級 AI 和可行的商業模式已經匯合。然而,這個拐點的真實性,最終將由 2028 年的工廠部署數據和 2029-2030 年的單位產量來驗證。

主題二:Panther Lake 的準時赴約,Intel要強勢歸來?

在CES 2026的鎂光燈下,Intel確實打出了一張漂亮的牌。Panther Lake的問世,就像一場遲來的及時雨,澆熄了市場對其「四年五節點」路線圖最大的疑慮。

Panther Lake的成功,究竟證明了什麼?又掩蓋了什麼?

讀懂Intel的戰爭語言

在分析之前,我們先來解釋一下Intel的語言。

什麼是 Panther Lake?

你可以將「Panther Lake」理解為Intel為2026年筆記型電腦市場打造的新一代「大腦」。

它不是單一晶片,而是一個完整的處理器系列(Core Ultra 3/5/7/X),將成為從輕薄本到高性能筆電的心臟。

它的使命,就是要向世界證明,在AI時代,Intel依然能定義什麼才是一台「好電腦」。

什麼是 18A 製程?

如果說處理器是建築,那「製程」就是建造這棟建築的工藝藍圖與技術水平。

數字越小,代表工藝越先進,可以在同樣大小的晶片上,塞進更多、更小、更省電的電晶體。

18A,可以理解為1.8奈米級別的技術,是Intel暫時最頂尖的製造工藝。

一場洗刷十年恥辱的執行力革命

對 Intel 而言,Panther Lake 最重要的數據不是效能增長,而是 2026 年 1 月 27 日 這個上市日期。

從10奈米到7奈米,Intel在過去十年飽受製程延宕的折磨,信譽幾乎破產。Panther Lake的如期而至,代表著Intel的工廠,終於能再次跟上自家PPT的腳步。

這是一場關於「執行力」的自我救贖。

無論是遊戲中的幀數,還是每瓦性能的提升,Panther Lake的實測表現基本兌現了Intel在發表會上的承諾。

這意味著18A製程的兩大基石:RibbonFET與PowerVia技術,並非實驗室裡的屠龍之技,而是能帶來實質性能優勢的「黑科技」。這重建了市場對其技術路線的信任。

更關鍵的是,Intel並非只拿出幾顆「特挑」的黃金樣品,而是在全球同步推出了橫跨200多款OEM設計的完整產品線。這證明18A製程已具備規模化量產的能力,良率正走在一條可預測的爬坡曲線上。這場仗,Intel打得有備而來。

總結來說,Panther Lake證明了18A製程「能用、好用,且能大規模製造」。

技術上的「可行性」不等於商業上的「競爭力」

Panther Lake證明了18A「能做」,卻沒證明它「做得便宜」。

60-70%的初期良率,對比台積電N2製程仍然有10-15個百分點的差距,是一道無法迴避的數學題。它直接轉化為更高的單位成本、更低的產出效率。

這意味著,用18A為自己生產晶片或許可以不計成本,但要以此說服蘋果、高通等外部客戶放棄台積電,幾乎是不可能的任務。在晶圓代工的戰場上,成本就是生命線。

更重要的是,Intel 證明了 18A 能幫「自己」做晶片,卻沒能證明能幫「別人」做晶片。CES 上除了已知的微軟合作案,完全沒有 Apple、Qualcomm 或 Broadcom 等重量級外部客戶的簽約消息。

沒有外部客戶,18A 就只是一個昂貴的內部玩具,而非真正的代工事業。

同時,他們雖然提到 14A 進度領先,但缺乏具體客戶回饋。加上在這場大會中,Intel所有的聚光燈都給了消費級產品,這讓外界懷疑 Intel 在高毛利的資料中心市場是否仍處於守勢。

一場止血,而非反攻

Panther Lake的問世,是一次至關重要的「止血」。它驗證了Intel的執行力,穩住了搖搖欲墜的軍心,為自己贏得了喘息的時間與空間。

但要重回巔峰,市場在等待的是 在未來幾個季度的財報。屆時,冰冷的良率數字、毛利率變化以及那份「夢寐以求」的外部客戶名單,將會給出最終的答案。在那之前,Intel 依然只是一個「正在康復中」的巨人。

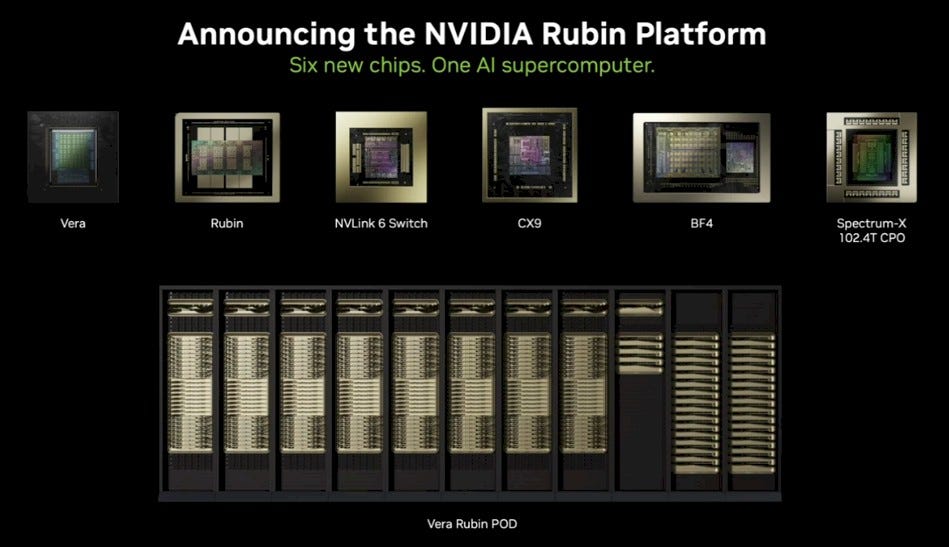

主題三:「六位一體」的戰爭機器,拆解 NVIDIA Vera Rubin 的系統級宰制力

Vera Rubin的出現,宣告了「單顆晶片打天下」的時代正式終結。

在CES之後,很多人還在糾結Rubin的PFLOPS翻了幾倍,但這其實看錯了重點。黃仁勳這次真正祭出的殺招,不是更強的GPU,而是「極致協同設計(Extreme Co-design)」。

這一次,NVIDIA不再只是給你一顆引擎,而是直接把整台F1賽車的底盤、傳動、甚至連維修站的補給系統(六顆晶片)全部焊死在一起。

核心困境:「網路之牆」

要理解Rubin的設計哲學,必須先理解AI基礎設施現在面臨的瓶頸:等待。

簡單來說,GPU的算力增長速度遠遠超過了數據傳輸的速度。結果就是,耗資數百萬美元的GPU叢集,其真實利用率常常只有40-50%。

剩下的時間,這些昂貴的矽晶片都在「空轉」,焦急地等待數據從網路的另一端緩慢爬來。這不僅是效率問題,更是經濟災難。

不斷推進GPU的性能其實也無濟於事,只要一天其他部件效率沒有提高,連接的效果沒有變好,真實利用率只會保持在低位。

Vera Rubin的誕生,就是為了用一種極其徹底的「系統工程」手段,徹底推倒這堵牆。

六位一體的協同作戰

Rubin平台的靈魂在於「極致協同設計」(Extreme Co-design)。這意味著平台上的六顆晶片,從設計的第一天起,就不是獨立的零件,而是作為一個統一的機櫃級系統被同時構思、同時優化。

讓我們來認識一下這顆晶片上的的每個成員:

1. Vera CPU — 數據總指揮:

在以訓練為主的時代,AI是「計算密集型」任務。GPU利用率高達85-95%,而CPU僅負責加載數據、調度任務,利用率低至10-20%。

當時的共識是:「CPU無關緊要,隨便一顆Xeon都能用。」

但到了2025-2026的「推理時代」,情況完全反轉。AI推理的第一步(把文字變標記)和最後一步(把標記變文字)都是CPU密集型的工作。

GPU處理一個Token只要微秒級,但CPU進行批次處理(Batching)可能要毫秒級。這1000倍的速度差,導致GPU有99%的時間在等CPU把下一批數據準備好。

當我們進入「長文本(Long-context)」和「代理型 AI(Agentic AI)」時代,CPU需要管理的KV Cache規模呈幾何級數增長。如果CPU慢,GPU利用率會直接從90%掉到40%。

這就是Vera CPU存在的理由。它並非一顆像Xeon那樣的通用CPU,而是一顆為AI協調而生的88核定製化Arm處理器。

它的架構被優化,專門用於處理Token化、請求批處理、以及在三級記憶體(GPU HBM4、CPU DRAM、ICMS儲存)之間進行複雜的KV Cache調度。

它與Rubin GPU之間那條1.8 TB/s的NVLink-C2C高速通道,正是為了實現這種無縫、低延遲的協調而存在。

2. BlueField-4 DPU — 基礎設施總管:

我們先來理解一下黃仁勳口中的「第三運算支柱」:DPU(數據處理單元)。它的唯一使命,就是在資料中心內高效地移動數據。

在現代的超大型AI資料中心裡,有一種東西叫 「資料中心稅」(Datacenter Tax):意指CPU有大約30%~40%的效能都被浪費在處理網路封包、安全檢查這些「雜事」上,而不是在跑真正的AI程式。

有了DPU,它就能把這30%的雜事接手過來,CPU就能100%全力投入在指揮AI運算。一個DPU本質上是一個小型電腦,整合了多核CPU(負責控制)、高性能網路介面(負責數據處理)和硬體加速引擎。

這正是BlueField-4在Rubin體系中的角色。它內建一顆64核Grace CPU,專門處理所有與AI計算無關的「髒活累活」:網路封包處理、ICMS儲存I/O協調、安全隔離、遙測監控。

這就像為CEO配備了一個萬能的執行長辦公室,讓他可以專心於戰略決策。

正是因為BlueField-4接管了所有基礎設施工作,Vera CPU才得以被徹底解放,100%專注於更高價值的AI協調任務。

其餘成員:各司其職,協同作戰

3. Rubin GPU — 算力引擎:

50 PFLOPS的推理性能固然亮眼,但那只是標題。真正的重要在於22 TB/s的HBM4記憶體頻寬,是Blackwell的近三倍。

為何這如此重要?因為當前最前沿的長文本推理(Long-Context)和專家模型(MoE),瓶頸從來不在於計算,而在於記憶體頻寬。

4. NVLink 6 Switch — 機櫃內神經系統:

如果說GPU是肌肉,NVLink 6就是連接它們的神經。它將每顆GPU的雙向頻寬翻倍至3.6 TB/s,在72顆GPU之間建立了一個真正的「全通訊」(all-to-all)網路。

這徹底消除了MoE模型中因數據交換而產生的內部瓶頸,如同為大腦的每個神經元都建立了直連通路。

5. ConnectX-9 SuperNIC — 智慧交通警察:

傳統網卡是被動的。而SuperNIC則是一個主動的「交通警察」,它在數據流量產生的源頭就進行整形和擁塞控制。它不是在交通堵塞後去疏導,而是在一開始就杜絕了堵塞發生的可能。

6. Spectrum-6 Ethernet Switch — 跨系統高速公路:

如果NVLink 6是機櫃內的「局域網」,Spectrum-6就是連接數千個機櫃的「廣域網」。它採用了先進的矽光子技術,以5倍的能效提升,將整個資料中心連接成一個無縫的、巨大的AI工廠。

協同設計如何解決真實痛點?

還記得我前幾天提過的「推論上下文記憶體儲存平台」(Inference Context Memory Storage Platform)嗎?(還未看的快去看)

這之所以可能,是因為BlueField從設計之初就知道Spectrum-X的傳輸模式,而GPU的軟體也知道何時該預取數據等等。結果是,長文本處理速度提升5倍。

而專家模型(MoE)需要在大量GPU之間進行密集的「全通訊」,Blackwell的NVLink在超過60顆GPU後就會達到飽和。

在Rubin的架構中NVLink 6將頻寬翻倍,並將SHARP(網路內計算)功能直接整合進交換器,分擔了大量通信開銷。

這使得訓練同樣規模的MoE模型,所需的GPU數量僅為Blackwell的四分之一,代表效率上升了4倍。

從賣「零件」到賣「系統」,護城河的再次加深

Vera Rubin的發布,標誌著NVIDIA商業模式和競爭壁壘的重大轉變:

單一晶片的FLOPS競賽正在變得次要。AMD的MI500或許能在原始算力上追平Rubin GPU,但它能同時拿出與之完美匹配的BlueField、NVLink和全套軟體生態嗎?

這套六晶片協同設計的架構,與CUDA軟體生態深度綁定,創造了巨大的轉換成本。

客戶購買的不再是一塊GPU,而是一整套預先整合、深度優化的「AI工廠解決方案」。這種系統級的鎖定,遠比單一硬體的性能優勢更為堅固。

Vera Rubin 宣告了「拼湊零件」時代的結束,和「系統為王」時代的到來。

Rubin平台上的每一項技術單獨來看都是「進化」,但當它們被「協同設計」這個核心理念串聯起來時,其產生的化學反應是「顛覆性」的。

p.s. 這裡沒有細說NVLink,但NVLink絕對是Nvidia的重要護城河之一,有興趣可以重溫舊文。

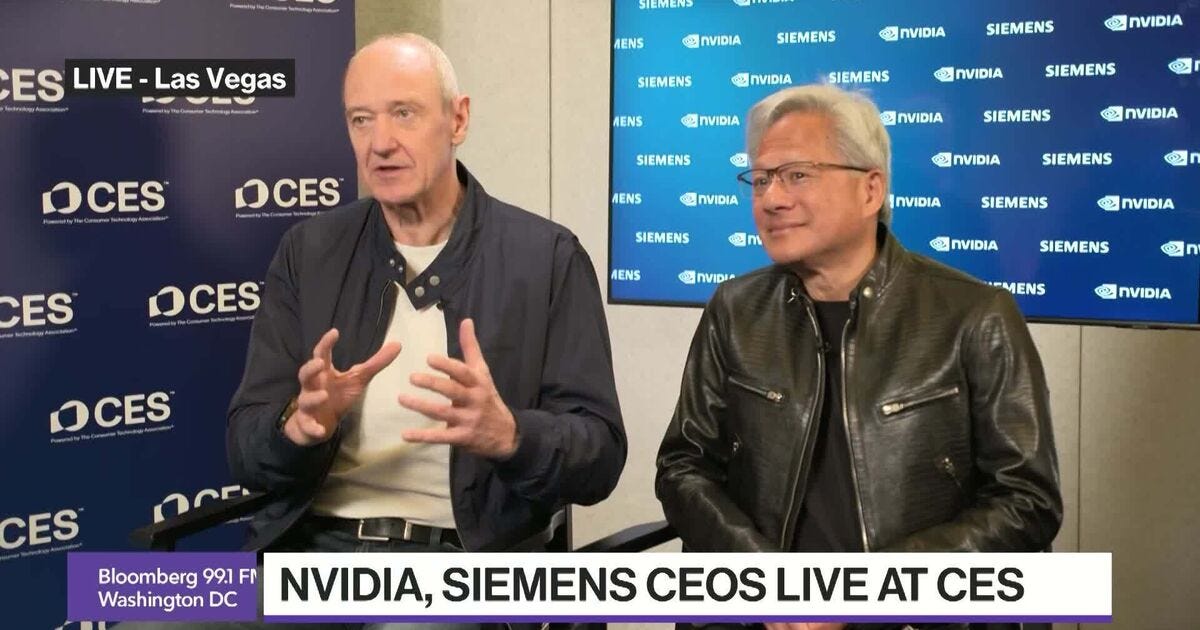

主題四:工業宇宙的作業系統,解析西門子與 NVIDIA 的聯盟

西門子宣布和Nvidia合作擴展為「工業 AI 作業系統(Industrial AI Operating System)」,將 NVIDIA 的算力基因,徹底植入全球數十萬名西門子工程師所構築的工業帝國中。

這個聯手開啟了一個新時代的序幕:一個由加速運算定義、AI 驅動、虛實完全融合的「物理 AI」(Physical AI)時代。

工業巨人的全貌

在深入探討這場革命之前,我們必須先精準定位西門子在這場聯盟中的角色。

許多人對西門子的印象可能還停留在「德國製造」的家電或工業自動化設備上。這固然沒錯,但這只是冰山一角。

其今日真正的核心與靈魂,是它龐大的「數位工業」軟體組合Xcelerator,大家可以將 Xcelerator 想像成是專為整個工業世界打造的「作業系統」。

1. 複雜模擬與虛擬測試:

在製造任何實體原型之前,西門子的軟體(如 Simcenter)需要在虛擬世界中進行成千上萬次的流體力學、結構強度和電磁模擬。

這些任務的計算量極其龐大,傳統 CPU 需要數天甚至數週才能完成,而 NVIDIA 的 GPU 加速運算能將其縮短到幾小時。

2. AI 驅動的設計與工廠優化:

無論是利用 AI 生成最優化的零件結構,還是在數位工廠中預測生產瓶頸並進行排程優化,都需要強大的 AI 訓練和推理能力,這恰好是 NVIDIA AI 平台的專長。

3. 創建物理級逼真的數位雙生:

要建立一個能與物理世界即時互動、視覺上極度逼真且行為符合物理定律的「活體」數位雙生,需要 NVIDIA Omniverse 平台提供的即時光線追蹤和物理模擬引擎。

簡而言之,西門子提供了工業世界的「應用程式和作業系統」,而 NVIDIA 則提供了能讓這一切以指數級速度運行的「超級晶片和底層引擎」。

掙脫 CPU 枷鎖,解放設計與模擬的枷鎖

過去數十年,從晶片設計(EDA)到飛機的流體力學模擬(CFD),整個工業軟體世界都建立在 CPU 的基石之上。CPU 擅長處理複雜的單線程邏輯,這與工業演算法的循序特性不謀而合。

然而,自 2010 年後,CPU 性能的「擠牙膏」式增長,早已追不上工業設計複雜度的指數級爆炸。

一個先進製程的晶片驗證,動輒在 CPU 叢集上跑上數週;一款新車的風阻模擬,需要耗費數十小時。設計工程師們撞上了一堵無形的牆,產品的迭代速度被運算力死死地卡住了喉嚨。

而 NVIDIA 的出現,帶來了 GPU 加速運算這把利刃。透過將 NVIDIA 的 CUDA-X 函式庫、cuSOLVER 等加速引擎,引入 PhysicsNeMo 這類生成式物理模型,令過去需要數週的設計優化週期,如今可能在一天內完成。

過去,工程師需要運行 100 次、每次耗時數小時的模擬來尋找最優解;現在,他們只需在 GPU 上運行 20 次模擬來訓練一個 AI 模型,剩下的 80 次探索,AI 可以在幾秒鐘內「預測」出結果。

物理 AI vs. 數據中心 AI

事實上,運行在工廠裡的「物理 AI」,與我們熟知的、運行在雲端數據中心的 AI(如 ChatGPT),是兩種截然不同的物種。

資料中心 AI(機率導向): 處理的是資訊位元(Bits)。它基於統計機率,偶爾的錯誤(幻覺)在可接受範圍內,且對延遲的容忍度較高。

物理 AI(定律導向): 處理的是實體原子(Atoms)。它必須嚴格遵守能量守恆、質量守恆等物理定律。

例如,在生產線上即時檢測瑕疵品並立刻停機。這裡追求的是極致的低延遲與可靠性。正是這種根本性的差異,決定了你不能簡單地把雲端 AI 搬到工廠裡。

工業界需要的是一套截然不同的、從晶片到軟體都為「即時、可靠、本地化」而生的專用架構。西門子與 NVIDIA 的聯盟,正是為了確保 AI 在工廠邊緣端(Edge)能實現極致的低延遲、高可靠性與物理準確性。

從「標本」到「活體」

這場聯盟最令人興奮的成果,莫過於賦予了「數位雙生」(Digital Twin)真正的生命。那麼,到底什麼是數位雙生?

想像一下,你為你的愛車拍了一套極其精細的 3D 寫真集,鉅細靡遺地記錄了它每個零件的樣貌和規格。

這就是過去的數位雙生,一個精美的、高保真的「數位標本」。它可以用於展示、查閱,但它本身是靜態的、被動的。

但今日的自主數位雙生,不只能做到這點。現在,想像你不僅有了這本寫真集,還在虛擬世界中創造了一個和你的實體車一模一樣的「活體」。

這個虛擬活體擁有自己的物理引擎(Simcenter),能模擬真實世界的力學和流體;它擁有自己的大腦(PhysicsNeMo),能從數據中學習並預測行為;它還擁有自己的神經系統,能與實體車的感測器即時同步。

它不再是一個被動的標本,而是一個永不疲倦、在虛擬世界中進行著持續優化實驗的「自主大腦」。

它能即時分析真實工廠的數據,在虛擬空間中測試數千種改進方案(例如調整產線佈局、更換機器人手臂),然後將被驗證為最優的方案,直接部署回物理世界。

百事可樂(PepsiCo)的案例完美地詮釋了這一點。他們在動工前,在虛擬世界中發現了 90% 的潛在問題,最終實現了 20% 的產能提升 和 10-15% 的資本支出削減。

一場雙贏的合作

然而,這條通往未來的道路並非坦途。 實現這一切的核心技術,NVIDIA Omniverse 平台,正處於一個關鍵的十字路口。

根據不同的報導,儘管 NVIDIA CEO 黃仁勳對其寄予厚望,將其視為價值數兆美元的市場機會,但 Omniverse 在過去幾年的商業化進程中卻進展甚微。

據報導,由於需求不足,其 Omniverse Cloud 服務一度關停;開發者抱怨軟體難用、功能不全;工程資源過度投入於無法產品化的演示中,讓黃仁勳本人也感到沮喪。

這使得與西門子的聯盟,不僅僅是一次市場擴張,更成為 NVIDIA 的一場戰略需要。

與其單打獨鬥地向市場推銷一個尚不成熟的平台,不如將其深度嵌入像西門子這樣的工業巨擘的生態系統中。

透過西門子全球數十萬工程師和龐大的客戶基礎,NVIDIA 試圖為 Omniverse 創造一個無法拒絕的應用場景,強行拉動市場需求,從而克服其早期的採用困境。

對西門子而言,這次合作讓他們從一家賣設備、賣軟體授權的公司,轉型為一個靠持續優化和 AI 服務來賺錢的平台公司。他們的 Xcelerator 平台,就像是工業界的 App Store,而 NVIDIA 提供了底層的硬體和作業系統。

工業世界的遊戲規則正在被改寫。競爭的焦點,已從單點的軟體功能,轉向了誰能提供一個從設計到營運、從硬體到軟體、從雲端到邊緣的「全棧式整合平台」。

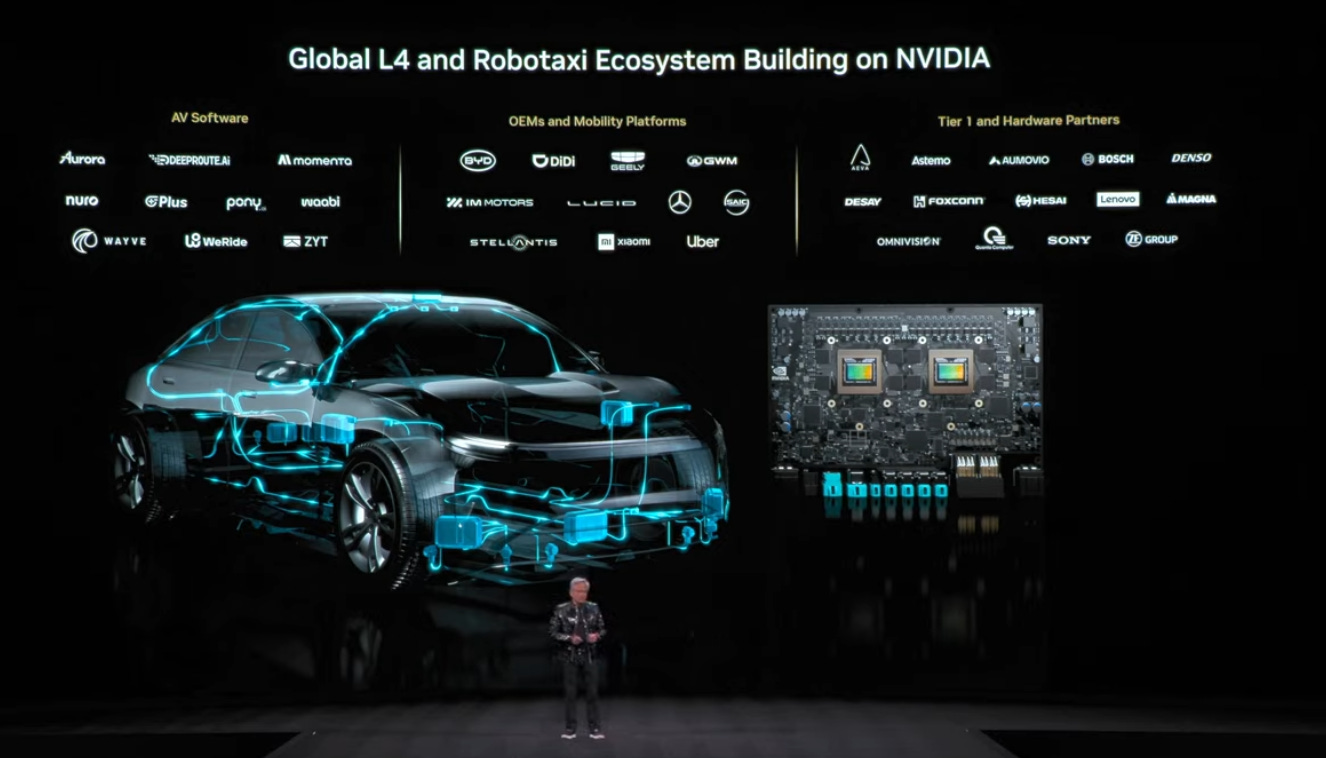

主題五:自動駕駛的「Android 時刻」,Alpamayo 究竟想如何挑戰 Tesla 和 Waymo?

在自動駕駛的賽道上,過去只有兩條路:一條是 Tesla 的「垂直整合模式」(自己造晶片、造車、寫軟體),另一條是 Waymo 的「封閉營運模式」(高成本、地理圍欄)。

Alpamayo 的出現,是第三條路:平台化。

它想做自動駕駛界的 Android,讓所有不想被 Tesla 甩開、卻又沒能力研發底層 AI 的傳統車廠(如賓士、豐田、通用),能直接「租借」NVIDIA 的大腦。

會「解釋」的 AI(Chain-of-Thought Reasoning)

首先,Alpamayo 究竟是什麼?它並非Nvidia自己跳下來搞自動駕駛,而是提供一個完整的生態系統,其核心旨在幫助任何汽車製造商(OEM)或計程車隊營運商,打造出自己的 Level 4 自動駕駛能力。

這個生態系統的核心,是一個名為 Alpamayo 1 的視覺-語言-行動(VLA)模型。但它與過去的 AI 模型有著根本性的區別:它引入了「思維鏈推理」(Chain-of-Thought Reasoning)。

這意味著什麼?過去的自動駕駛 AI,像一個神秘的「黑盒子」。它看到數據,然後給出一個指令(轉向、煞車),但你無從得知它「為什麼」這麼做,連工程師都難以解釋。這在監管機構眼裡是巨大的安全隱患。

而 Alpamayo 則像一個會自言自語的人類駕駛員,它會在做出決策前,生成一步步的、可被人類理解的邏輯鏈。例如,當車輛遇到故障紅綠燈時,系統會產生人類可讀的邏輯軌跡:

「偵測到紅綠燈故障 → 觀察四周無橫向來車 → 判斷安全 → 緩慢通過。」

當保險公司和政府要求解釋事故原因時,NVIDIA 的「可解釋性」將成為傳統車廠進入 Level 4 的通行證。

但當然,所有東西都不是沒有代價的。思維鏈推理的本質是生成額外的、用於解釋的「思考代幣」(Tokens)。

推理模型比傳統模型的功耗高出 2-3 倍。對於電動車而言,這意味著每天僅因運算就要多消耗數度電,直接削減了寶貴的續航里程。加上思維鏈的延遲性,也是 Nvidia 必需要考慮的事情。

最後,駕駛有時候是本能反應,多於一個精密的思考過程。加入了思維鏈,究竟會令自動駕駛變得更好還是更笨,仍然有待考察。

NVIDIA 的戰略意圖

NVIDIA 投入如此巨大的資源進入這個燒錢無數的領域,背後有三個戰略原因:

1. 尋找下一個萬億級市場:

黃仁勳已明確表示,在資料中心 AI 之後,以自動駕駛為代表的「物理 AI」(Physical AI)是 NVIDIA 的第二大增長機會。

當資料中心的 AI 晶片市場逐漸走向成熟甚至商品化時,NVIDIA 迫切需要一個能將其運算能力從雲端延伸至邊緣、從開發滲透至量產的全新戰場。

2. 成為「賣鏟人」,而非「淘金者」:

與親自造車的特斯拉和運營車隊的 Waymo 不同,NVIDIA 的定位是成為產業鏈上游的基礎設施供應商。

它賣的是一整套解決方案:從車載超級晶片(如 Drive AGX Thor,單價約 3,500 美元)、作業系統、AI 模型,到後端的訓練與模擬平台。

它希望複製在 AI 資料中心領域的成功模式:我不是最大的使用者,但我讓所有使用者都離不開我。

3. 終結「重複造輪子」的混亂局面:

當前,幾乎所有車廠都在各自為政地從零開始研發自動駕駛系統,這導致了巨大的資源浪費。

Alpamayo 提供了一個強大的架構,讓車廠可以在此基礎上進行微調和客製化,而不是從頭發明感知、規劃和控制系統。NVIDIA 試圖藉此一舉統一這個碎片化的市場。

用「模擬」取代「實測」

不過,大家可能都會明白,自動駕駛最重要的不只是技術,而是數據。這方面 Tesla 和 Waymo 有大量真實行駛數據,Alpamayo 又打算如何追趕?

這就又要說回 Nvidia 的 Omniverse 了。透過 Omniverse 的物理模擬,NVIDIA 宣稱能將模擬數據轉化為現實表現的誤差降低 83%。

這意味著,在理論上賓士不需要像 Tesla 那樣花十年去收集數據,只要在 NVIDIA 的數位孿生世界裡「跑」幾個月,就能獲得接近 Level 4 的能力。這是一場「以算法換數據」的賭注。

一個無法被繞過的生態系

NVIDIA 的策略在於,它不與任何車廠為敵,而是讓所有車廠都成為它的夥伴。其合作夥伴網絡已經遍佈產業的各個角落:

Mercedes-Benz:作為首個全棧式合作夥伴,賓士將於 2026 年第一季在美國率先推出搭載 Alpamayo 技術的 CLA 車型,這將是該平台首次大規模的「期中考」。

戰略級巨頭 (Toyota, GM):全球銷量第一的豐田和美國巨頭通用汽車,都已承諾在其下一代平台中整合 NVIDIA Drive 技術。

自動駕駛營運商 (Uber, Aurora):Uber 計劃在 2027 年前部署 10 萬輛基於 NVIDIA 架構的 Robotaxi;Aurora 則專注於無人駕駛卡車領域。

新興勢力與供應鏈 (Lucid, BYD, Foxconn):從豪華電動車品牌到全球最大的電動車製造商比亞迪,再到代工巨頭富士康,都已納入 NVIDIA 的生態版圖。

這形成了一個強大的網絡效應:當行業內越多的參與者採用 NVIDIA 的平台,這個平台的標準地位就越穩固,後進者選擇其他方案的機會成本就越高。

投資者該如何看這盤棋?

NVIDIA 的 Alpamayo 巧妙地避開了造車和運營這兩個資本最密集、回報週期最長的無底洞,轉而佔據了產業鏈中利潤最豐厚、最具控制權的一環。

但大家也要明白的是:這是一個正確的、但極其長期的故事。

對於投資者和觀察者而言,必須清晰地認識到:Alpamayo 的成功,取決於整個行業的成熟速度,而這個速度充滿了不確定性。

在未來 2-3 年內,NVIDIA 的核心故事仍然是其在資料中心 AI 領域無可匹敵的統治力。

自動駕駛業務將是一個重要的增長期權,但它更像是一場需要耐心等待的長線投資,而非能立即引爆財報的催化劑。

現在,全世界都在屏息等待 2026 年,看著賓士 CLA 的輪胎在真實道路上滾動時,這盤大棋將迎來它的第一次「期中考」。

主題六:Nvidia新架構不再需要散熱了嗎?

黃仁勳只用了一句話,就讓全球幾家空調與散熱巨頭的市值,在盤中瞬間蒸發了數十億甚至上百億美元。

他說:「我們未來的Vera Rubin平台,是用攝氏45度的溫水來冷卻的。在這個溫度下,資料中心不再需要傳統的冰水主機(Chiller)。」

市場的第一反應是:NVIDIA不再需要散熱了!這對整個散熱行業是毀滅性打擊!

於是,恐慌性拋售開始了。但事實上,要了解這個變化,我們要先了解一下數據中心是如何散熱的。

傳統散熱:在數據中心裡裝一台「巨型冰箱」

過去幾十年,數據中心的散熱邏輯是「冷卻空氣」。

你可以把大型冷水機組 (Chillers)想像成一台放在頂樓的巨型冰箱。它的任務是利用電力,強行把水溫降到很低(通常是 7°C 到 15°C)。

運作流程是這樣的:

冷水機組製造出冷水。

這些冷水流進室內的「空調箱(CRAH)」。

空調箱吹出冷風。

冷風吹向伺服器,帶走晶片的熱量。

問題在於,空氣的導熱能力非常差。當 AI 晶片像電磁爐一樣燙時,你就算把風扇吹到起火,也來不及帶走熱量。

而且,為了維持那台「巨型冰箱」運作,數據中心有 30%-40% 的電費是花在冷水機組上的。這就是為什麼傳統方式既浪費空間,又極度耗能。

液冷技術 (Liquid Cooling):把「水冷頭」直接貼在晶片上

液冷技術(特別是 Direct Liquid Cooling, DLC)跳過了空氣這個低效率的中介,直接用液體去「吸熱」。

運作流程是這樣的:

像賽車改裝一樣,在晶片表面貼上一塊金屬冷板。

液體(通常是水或特殊冷卻液)直接流過這塊冷板。

液體直接帶走晶片的熱量,然後流出伺服器。

為什麼這樣更好?水的導熱能力是空氣的 25 倍以上。

這意味著你可以用更小的體積,處理更多的熱量。這也是為什麼 NVIDIA 的高階機櫃(如 NVL72)必須強制使用液冷,因為空氣已經「吹不動」這些怪獸晶片了。

Vera Rubin 革命:為什麼「不要冰箱」,卻更需要「水管」?

讓我們回到CES大會上,黃仁勳說到:「我們用 45°C 的溫水來冷卻。」

這聽起來很反直覺:45°C 的水不是溫的嗎?怎麼冷卻晶片?

事實上,只要晶片表面是 80°C-90°C,45°C 的水對它來說依然是「涼爽」的,足以帶走熱量。

那麼,既然我們只需要 45°C 的水,那我們根本不需要那台耗電的「巨型冰箱(冷水機組)」來製造 15°C 的冷水了。

我們只需要把 45°C 的熱水排到室外,利用室外空氣(假設是 30°C)進行自然熱交換,水溫自然就會降下來。

這就是為什麼 NVIDIA 的改變依然需要「液冷技術」:雖然我們不需要「冷水機組(Chiller)」來製造人工冷能,但我們比以前更依賴「液冷循環系統」。

更精密的 CDU (液冷分配單元):既然沒有了冷水機,系統需要更聰明的泵浦和控制閥,來精確控制這 45°C 的溫水流量。

更龐大的歧管 (Manifolds):每一台伺服器、每一個晶片都要接水管。這就像是從「中央空調」變成了「全屋地暖+水管系統」。

更高效的熱交換器:雖然不用冰箱,但我們需要巨大的「乾冷器」在室外散熱。

散熱的需求不但沒有消失,反而因為晶片功耗暴增(Rubin平台單顆晶片功耗高達2300W),散熱問題變得比以往任何時候都更加棘手。

消失的,只是那台笨重、耗電的「車庫大冷氣」而已。

這場變革,清晰地劃分出了兩個陣營:未來的贏家與輸家。

傳統冰水主機(Chiller)巨頭的情況

傳統 HVAC(暖通空調)巨頭,他們的核心業務之一就是製造那些大型的冰水主機。他們就像是世界上最會造「車庫大冷氣」的專家。

當 NVIDIA 這位最重要的客戶直接宣布「我的新設計不再需要你的產品」時,市場的恐慌是完全可以理解的。

他們必須立刻、馬上轉向液冷解決方案,否則在 AI 資料中心這個增長最快的市場裡,他們將被徹底邊緣化。

液冷生態系的玩家

Vertiv 的前身是艾默生網絡能源(Emerson Network Power),它不只做散熱。它的業務核心是「數據中心基礎設施」,主要分為兩大塊:

電源管理 (Power):包含 UPS(不斷電系統)、配電櫃、開關櫃。這部分佔了它營收的很大一部分。

熱管理 (Thermal):包含傳統的精密空調、大型冷水機組,以及現在最火的液冷系統。

Vertiv 旗下一直有液冷產品線(如 Liebert 品牌),但過去 20 年,數據中心 95% 都是用風冷,所以液冷只是它的一個「小眾實驗室產品」。

雖然 NVIDIA 說「不需要冷水機組(Chillers)」,看似砍掉了 Vertiv 的一部分傳統生意,但實際上,液冷系統的「含金量」比傳統空調高得多。

傳統冷水機組像是一台巨大的工業設備,競爭者眾多,利潤透明。但 NVIDIA 要求的液冷系統,是一套「零容忍」的精密工程,這需要如Vertiv這種專家。

轉型不會一夜發生

儘管黃仁勳的願景很宏大,但投資者需要注意幾個現實邊界:

氣候限制:在亞利桑那州或中東沙漠,45°C 的溫水冷卻在夏天依然面臨嚴峻挑戰,機械製冷(Chiller)可能還是得作為備援。

存量市場:全球現有的數據中心不可能拆掉重建,混合架構(Blackwell + Rubin)會持續很長一段時間。

功耗悖論:雖然 Rubin 效率更高,但單顆晶片功耗已達 2,300W。這意味著熱密度變高了,散熱的「總預算」其實是在增加的,只是花錢的地方變了。

「協同設計」(Co-design)時代的來臨

過去,資料中心的建構是分工的:NVIDIA 賣晶片,戴爾/惠普賣伺服器,Vertiv 賣散熱,大家各自為政。

但現在,NVIDIA 不再只賣晶片,它賣的是一整套高度整合的「系統」。從晶片、電源、網路到散熱,所有環節都在設計之初就被通盤考慮、緊密耦合。

在「協同設計」的情況下,NVIDIA 能夠在其晶片加入了極其精密的「微通道冷板」。這些冷板內部蝕刻了無數微米級的流道,讓冷卻液直接流經晶片封裝的最深處。

這就是這場革命的物理學本質:不是因為 45°C 的水本身有多「冷」,而是因為我們把從晶片到水之間的「熱量通道」建得無比寬闊通暢。

散熱不再是事後的補救措施,而是整個架構設計的核心一環。這意味著,散熱公司未來無法再像過去一樣,單純地銷售標準化產品。他們必須成為 NVIDIA 生態系中的合作夥伴,能夠參與到前期共同設計中。

誰能與NVIDIA緊密合作,誰就能掌握未來的訂單。

一句話,劃開了新舊時代

所以,讓我們回到最初的問題。黃仁勳的那句話,並不是給散熱行業判了死刑。他其實是劃出了一條線,線的一邊是過去,另一邊是未來。

他用最直白的方式告訴市場:依賴舊有技術、無法適應系統級整合的公司將被淘汰;而那些早已佈局液冷、並能融入新生態系的玩家,將迎來前所未有的增長。

散熱的預算依然存在,只是從購買「冰水主機」,轉移到了購買更精密、更高效的「直接液冷系統」。

主題七:AMD打算如何追趕Nvidia?

當 NVIDIA 宣佈了排山倒海的新技術後,我們下一個問題很自然地就會是:AMD 還能追上嗎?

在這次 CES 大會中,蘇姿丰(Lisa Su)用她的演講給出了答案。

雖然 AMD 的口號依然是溫暖的「AI 無處不在」(AI Everywhere, for Everyone),試圖展示從雲端到邊緣的完整版圖,但明眼人都看得出來,整場演講的靈魂、時間分配與舞台焦點,全都留給了那個最核心的戰場:數據中心。

數據中心的全棧式進攻

AMD 這次發佈了Helios AI機櫃,要理解其重要性,必須先明白它與過去的區別。

這並非AMD首次推出機櫃,但Helios是其第一個從零開始、為AI而生、完全整合的「機櫃級平台」。

在Helios之前,AMD的MI300/MI350機櫃,更像是將一堆高效能的樂高積木(GPU)堆疊在一個標準化的架子上。它們採用了行業標準的「通用基板」(UBB),追求的是模組化的彈性,而非極致的整合效能。

其內部互連技術XGMI在超過8個GPU後擴展性不佳,使得整個機櫃更像是「128個獨立GPU節點的集合體」,而非一個統一的超級電腦。

這一切轉變的催化劑,是AMD在2025年3月的一項關鍵收購:ZT Systems。

這次收購為AMD帶來了超過1000名頂尖的數據中心系統工程師。這次收購讓AMD完成了從「零件組裝廠」到「整體架構設計師」的蛻變,賦予了他們從頭打造一個整合平台的能力。

在此之前,AMD在面對NVIDIA的NVL72/NVL144等真正一體化的機櫃級系統時,並沒有對等的武器。Helios的出現,意味著AMD終於能夠在「架構整合」的維度上與NVIDIA正面對決,而不僅僅是在單顆GPU的規格上追逐。

真相:Helios使用的並非「完全體」的UALink

聽起來 AMD 已經具備與 NVIDIA 一戰的實力了,對嗎?我們得看看細節。

在 Helios 中,雖然 GPU 透過全新的 UALink 架構互連,號稱能像單一引擎般協同工作。但深入探究會發現,AMD 目前採用的是 UALink Over Ethernet (UALoE)。簡單來說,這是一個「過渡版本」,底層跑的依然是乙太網路。

AMD之所以這麼做,只有一個原因:時機。

真正能與NVLink在物理層面抗衡的「原生UALink」交換機晶片,需要由Marvell和Astera Labs等合作夥伴提供,但它們要到2026年底甚至2027年才能準備就緒。

相比之下,NVIDIA 擁有自家的 NVSwitch 和原生 NVLink 的 Co-design 優勢。這導致 Helios 在延遲與集體運算效率上,短期內依然無法完全等同於 NVIDIA 的頂級表現。

戰略定位:一個「足夠好」的第二選擇

這個技術妥協,清晰地定義了Helios的市場定位。它並非旨在全面擊敗NVIDIA,而是要成為一個極具競爭力的「第二選擇」。

當 OpenAI 總裁 Greg Brockman 親自登台與蘇姿丰並肩而立時,信號已經很明確了:AMD 已經是頂級 AI 巨頭認可的、可信賴的基礎設施供應商。

對於訓練(Training)市場:這是 NVIDIA 的利潤堡壘。對於追求極致效率、分秒必爭的頂級實驗室,NVLink 系統仍是首選。

對於推論(Inference)市場:這才是 AMD 的主戰場。當模型訓練完成進入大規模部署,市場對延遲的容忍度會提高,但對成本、供應鏈多樣性、記憶體頻寬的需求會激增。

Helios 在這裡表現得「足夠好」,加上開放標準帶來的靈活性,使其成為 Oracle、Azure 等雲端巨頭構建推論基礎設施時,最能制衡 NVIDIA 的利器。它讓客戶擁有在NVIDIA之外的真正選擇權,從而打破壟斷,這本身就是重要的。

開闢新局 :專業與邊緣AI的側翼騷擾

如果數據中心是正面戰場,那麼「實體 AI」(Physical AI)就是 AMD 開闢的側翼陣地。AMD 推出的 Ryzen AI Embedded P100/X100 系列,直接瞄準汽車、工業自動化與機器人。這些產品具備寬溫工作能力(-40°C 至 +105°C)與 ASIL-B 汽車安全認證。

Blue Origin亦宣佈,其月球著陸器將搭載AMD晶片,證明了AMD在邊緣AI受到一定的認可。

在這些需要極高穩定性與特殊環境適應力的領域,NVIDIA 尚未建立絕對的統治力,這給了 AMD 極大的發揮空間。

從「獨角戲」轉向「雙雄爭霸」

黃仁勳讓全球看到了 AI 的「天花板」,而蘇姿丰則正在鋪設 AI 的「地板」。

AMD 在 CES 2026 展示的不再是挑戰者的姿態,而是一個成熟供應商的形象。這場變革對產業是健康的:當市場不再只有一種聲音,創新的成本才會下降,AI 的應用才會真正爆發。

這塊蛋糕增長得夠快,每個人都能分一杯羹。

主題八:當算力戰爭打到發電廠,xAI的「能源獨立」大計

好了,終於到最後一個主題,也是唯一一個不是CES中的主題。

電力是AI下一個瓶頸,相信大家都已經有一定的了解,每家巨頭現在都正在努力尋找充足的電力供應。

在最近,xAI斥資數十億美元,繞過傳統電網,直接採購近2 GW(吉瓦)的天然氣渦輪發電機組,在孟菲斯(Memphis)等地自建燃氣發電廠。

不過,這一次的主角,卻不是我們熟悉的GE,西門子等等,而是一家叫斗山的韓國公司。

不是因為「更好」,而是因為「能買到」

這次採購名單中的主角杜山 DGT6-300H.S2,是韓國首款自主研發並出口美國的H級燃氣輪機。這是一個極具象徵意義的時刻。

過去這個領域被GE、西門子、三菱等老牌巨頭壟斷,但杜山用11年的時間走完了別人幾十年的路。這台機器的技術指標令人驚嘆:它能在12分鐘內快速啟動,每分鐘增加55 MW的出力。

斗山的渦輪機在效率上與GE的旗艦型號相差無幾。GE在空氣動力學設計上或許更激進,但斗山也有PCHE(印刷電路板式熱交換器)等巧妙的創新,特別適合空間有限的資料中心部署。

但重點是,GE和西門子手握3-5年的訂單,產能早已排到2029年之後。它們是典型的「賣方市場」,根本無法滿足xAI對速度的渴求。

而斗山,作為一個急於打入國際市場的後起之秀,產能相對充裕,能夠承諾在2026年底就交付。

於是,Elon Musk選擇了那個能立即到貨的「優良」武器,而不是那個需要等待兩年的「完美」武器。

Megapack,非賣品級的必需品

如果說渦輪機是心臟,那麼特斯拉的Megapack儲能系統絕非「配件」,而是維持心跳穩定的「心臟節律器」,是整個架構中不可或缺的一環。

原因在於AI訓練負載的獨特物理特性:

極端波動:AI叢集在運算和通訊狀態間切換時,功耗會在毫秒內從基線暴增或暴跌±90%。

高頻振盪:這種波動頻率高達30赫茲(每秒30次)。

想像一下,讓一台精密的噴射引擎每秒鐘在「怠速」和「全速」之間切換30次。其結果必然是災難性的機械損傷。對於燃氣渦輪機也是如此,這種高頻振盪會引發葉片共振、壓縮機喘振,使其預期壽命從40,000小時驟降至不到15,000小時。

Megapack的作用就是一個巨大的「電力減震器」。它以毫秒級的速度吸收和釋放能量,將這種毀滅性的高頻「噪音」過濾掉,只把平滑、緩慢變化的負載曲線傳遞給渦輪機。這讓渦輪機可以始終運行在最高效、最穩定的「舒適區」。

甚至,它能部份取代傳統資料中心昂貴的柴油備用發電機,節省了數億美元的資本支出和燃料費用。

在閒置時,Megapack還可以參與電網的頻率調節服務,產生額外收入。

它解決了一個物理學上的根本難題,讓大規模 AI 訓練與傳統發電設施的結合成為可能。

實戰驗證

市場上不乏電池供應商,但Megapack的核心競爭力在於軟體。

硬體是商品,但控制演算法是技術壁壘。特斯拉的VSM(虛擬同步機)軟體能讓電池模組在數學上模擬巨大旋轉渦輪的慣性,其頻率響應時間小於50毫秒,比競爭對手快數倍。

這種「預測性負載建模」能預判GPU訓練的脈衝模式,提前調整充放電,讓系統所需的電池容量減少15-25%,直接節省上億美元的資本支出。

這套「渦輪 + Megapack」的混合架構並非實驗室產物,而是已經在全球範圍內大規模運作:

xAI 孟菲斯集群:已部署156-168台 Megapack,總容量超過1.2 GWh,正活躍地平滑GPU訓練產生的波動。

Tesla Cortex 集群:在德州部署了500 MWh的Megapack,支撐10萬片 H100的電力運作。

Google Oberon 項目:同樣部署了1 GWh的儲能系統來繞過電網瓶頸。

當「電力」成為新的護城河

當Google收購Intersect Power,SoftBank不惜一切都要將DigitalBridge收入囊中,GE Vernova的訂單排到2028年,大家就明白,如何確保自家的電力,是現時巨頭們最煩惱的事情了。

能源獨立,將會是2026年基礎設施最重要的一環。

謝謝你閱讀到這裡,如果你覺得這份筆記為你帶來了價值,請不吝按下一個讚,這是我持續分享的最大動力。

另外我在Telegram有頻道,每天早上我會發當天重要新聞摘要。

同時,如果想開戶的話,可以考慮用我的富途/口袋證券獨家推薦碼,會有更多優惠。

全部資訊在以下鏈結:

另外,如果你已經加入付費會員,不要浪費了群組的功能,進入我們Substack的Chat功能一起討論市場!

KP

內容實在太豐富,到晚上才有時間讀完! 補充一點關於液冷,我早兩天也做過研究,Vera Rubin 用的是PG25 液冷劑,它的名稱源自其主要成分與比例:PG 代表 Propylene Glycol(丙二醇),而 25 則代表其濃度為 25%。

很期待在未來看到6G會與NOK有怎樣的聯動。