光進銅進或退?不同技術的時間表?大廠都在想甚麼?- 深入分析第40期:光通訊大會(OFC)2026

美國光纖通訊展,在往常只不過是一堆傳統電信商在拉網路線的展覽。

但上週在洛杉磯落幕的 OFC 2026(美國光纖通訊展),已經與以往截然不同。這場吸引了破紀錄 17,800 人、超過 700 家廠商 參展的全球最大光通訊盛會,本質上已經變成了一場「AI 基礎建設峰會」。

為什麼?因為微軟、Google、Meta、NVIDIA 這些 AI 巨頭們開始強烈感受到算力瓶頸的壓力。當 AI 叢集動輒塞入十萬顆 GPU,功耗與散熱問題已逼近機房極限。

整場大會最受關注的核心議題是:「銅 vs 光」。在 AI 資料中心裡,到底哪些地方該用銅線、哪些地方該用光纖?

大會呈現的共識是:未來不會有單一贏家,而是多種技術並存的過渡階段。

讀完這份分析,你將學會:

搞懂技術迷宮:不再被 LPO、LRO、NPO、CPO、XPO 等縮寫搞混,用「兩個座標軸」就能快速判斷每項技術的應用場景與優劣勢。

看清大廠底牌:微軟、Meta、NVIDIA、AWS、Google 五大巨頭的光學採購策略截然不同,了解他們的策略。

掌握投資節奏:2026-2028 年各有不同的技術主角,什麼時間點該關注什麼賽道。

識別真正瓶頸:InP 晶圓產能、OCS 訂單能見度、熱管理需求。這些才是決定供應鏈誰賺大錢的關鍵,而非表面的技術名稱。

部署投資策略:市場已 Price in 多少預期?什麼情況會引發 30-50% 回調?學會用「企業成長 vs 估值擴張」框架判斷自己賺的是哪部分的錢。

導讀:寫在開始前

可能大家收到這份分析的時候,心裡會閃過一絲疑惑。「不是上星期寫完電力分析上篇,這星期就該出下篇嗎?」

本來是的。但在光通訊大會結束後,我進行了大量研究,途中發現一個問題:資料極度散亂,技術名詞多不勝數,對絕大多數投資者極不友好。

即使你在不同地方看過各種分析,基本上都只能是「點」,看不懂全局。

原因很簡單,光通訊太過複雜,大會公佈的資訊量太大,專有名詞多到根本不可能理解每個東西的具體位置。

於是,我決定把這些資料聚集起來,化成一篇完整分析,把所有的「點」連成一線。

OFC 大會公佈的東西非常多,不可能全部寫完(不然至少 6、7 萬字),總得挑重點。但我相信,這會是你能看到最整體、最容易入口,同時保持一定技術深度的華文光通訊分析。

事先聲明,雖然老讀者都會清楚我將複雜東西解釋清楚的能力,但光通訊的複雜程度非同小可。如果要解釋每個名詞,會嚴重影響整體理解。

所以,如果看到有部份名詞我只是輕輕帶過,你又看不懂的話,直接略過就可以。 你需要了解的關鍵概念,我一定會解釋清楚。寫出這些技術名詞的原因,是方便想深入研究的朋友自行追蹤。

關於投資,我先說結論:光很好,潛力仍然很大,但也很貴。

我相信訂閱 FOMO 研究院的,都不是為了伸手抄作業的。但整篇分析的重點,是讓大家了解現在的具體進展、技術路徑、時間表。

最終希望達到的,是真正清楚自己在投資什麼,風險位置在哪兒。 如果未來出現大幅回調,可以回頭拿出這份報告,看看究竟是基本面變化了,還是技術邏輯不再成立。

幾個月前我寫過一篇深入的光通訊分析,是 FOMO 研究院至今最高人氣的文章。我會建議大家重溫一次(看完這篇前後都可以),對整個行業的認知會更上一層樓。

最後,如果可以先按個讚再閱讀,我會感激不盡,謝謝。

第一章:你需要記住的兩個座標軸

要搞懂這些眼花撩亂的光通訊技術,先來重溫兩個座標軸:「你的資料要去哪裡?」以及「你打算用什麼引擎?」

座標軸一:你的資料要去哪裡?(地理範圍)

想像你是 AI 企業總裁,員工(GPU)溝通距離決定網路選擇:

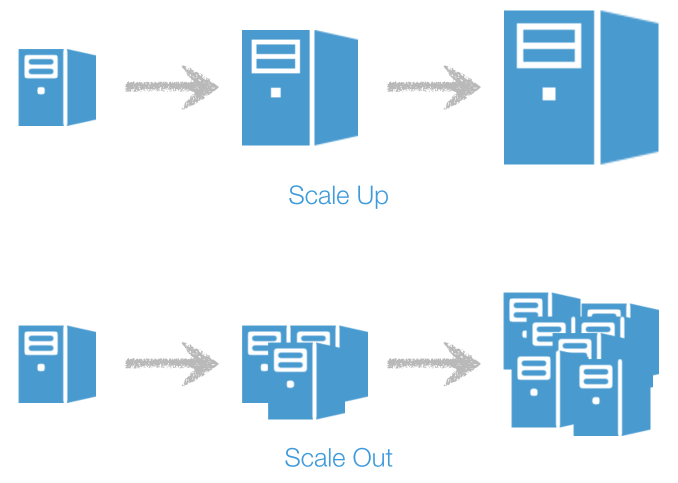

Scale-up(向上擴展 / 縱向擴充):頂級專家的高壓會議室

場景: 場景: 把同一機櫃內的幾十、上百顆 GPU 綁在一起,運作像一顆「巨型 GPU」訓練大模型。

現況: 專家需極度頻繁、毫秒不差地交頭接耳。過去是銅線天下,但現在距離和發熱到極限,光通訊須深入機櫃內部。

Scale-out(向外擴展 / 橫向擴充):跨國企業的中央廣播系統

場景: 單房間裝不下,將幾千個機櫃互連,組成巨大資料中心網路。

現況: 目前最成熟做法,依賴乙太網路或 InfiniBand。重點在於面板塞更滿、傳更遠、壞了好修。

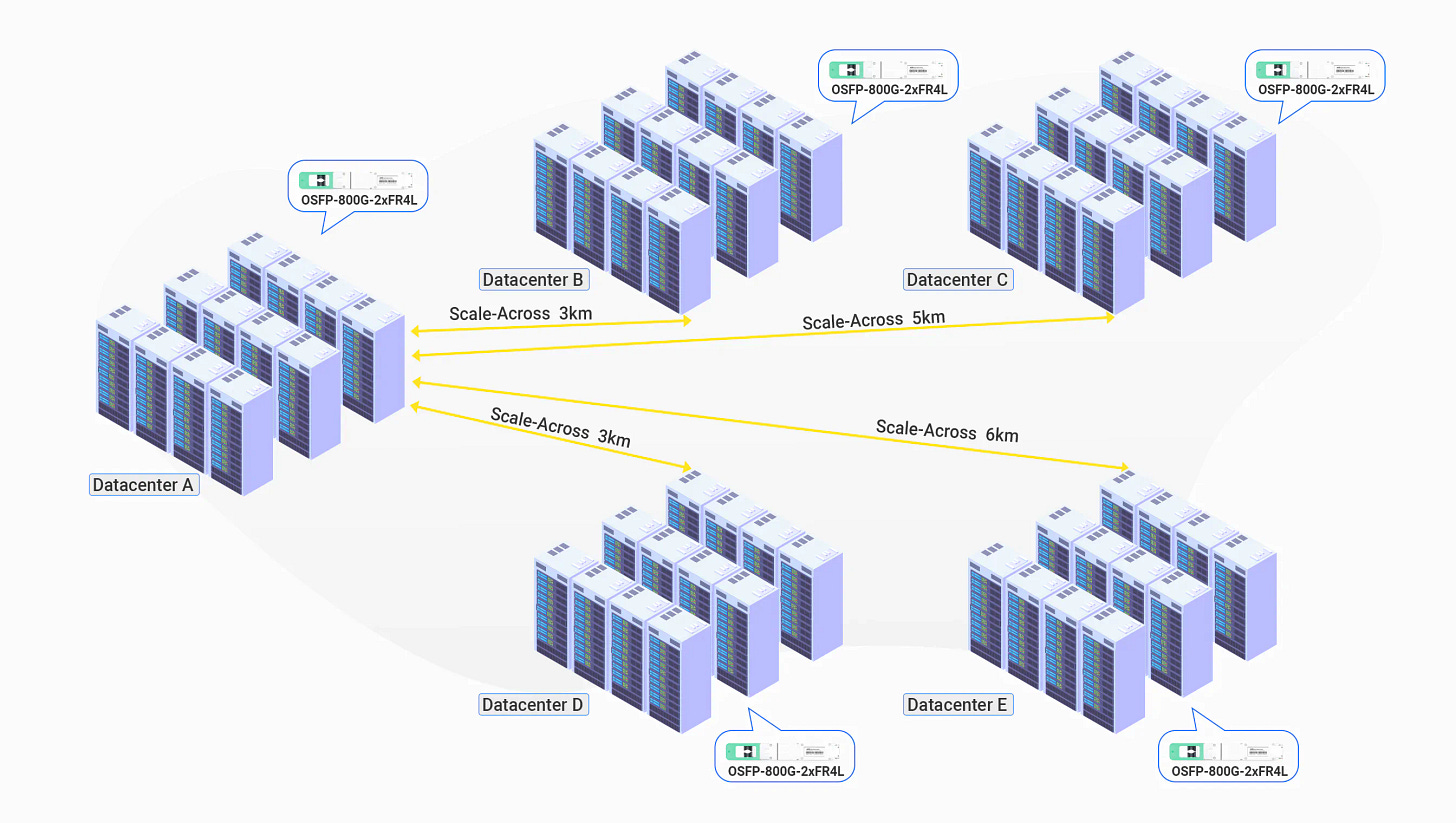

Scale-across(跨域擴展):城市間的高鐵網路

場景: OFC 2026 熱門第三維度。AI 訓練從「超級機房」走向「分散協作運算」。跨城市資料中心互連(DCI)年增速超過 50%。

座標軸二:你用什麼引擎?(光電轉換技術)

目的地確定,接下來挑選「翻譯官(光學模組)」。

為什麼會有這麼多不同技術?因為每種距離都會帶來截然不同的挑戰:功耗要壓到多低?散熱要多強?壞了要多好修?密度要多高? 這些 trade-off 讓產業發展出多種互補解法。

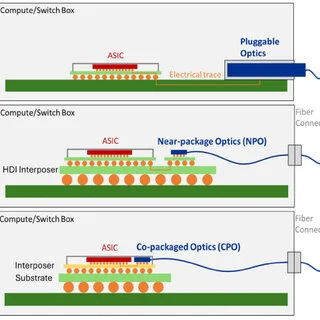

我們可以用「光引擎距離核心晶片有多近」來分類(這決定了省電程度與維修難易度):

1. 外接派(Pluggable Camp):主要應用在 Scale-out(機櫃間連線)

這派的特色是光學模組像 USB 隨身碟 一樣,插在機器的最外面(前面板)。好處是超級好修,壞了隨時拔換。

LPO(線性驅動): 「直腸子翻譯官」。大膽移除模組裡最耗電的 DSP(負責糾錯),讓交換器晶片自己處理雜訊。結果?省電 50%、幾乎零延遲。

LRO(線性接收光學): 2026 年真正量產的主力「務實翻譯官」。 它只拔掉接收端的 DSP,保留發送端糾錯能力, 省電 30-40%,大幅提升互通性與穩定性,已被 Google 與 Meta 大規模採用。

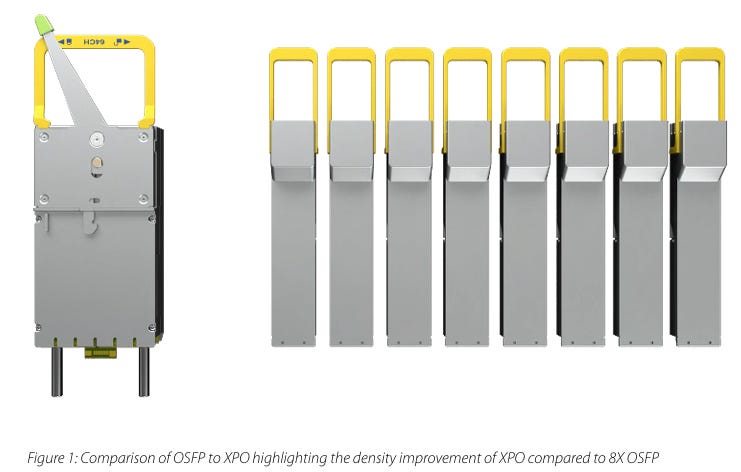

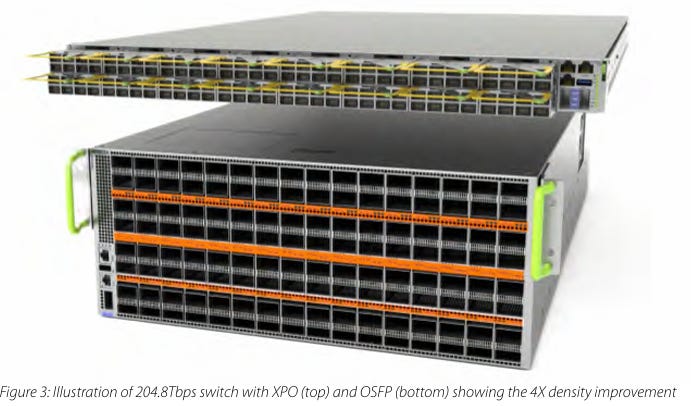

XPO(極致可插拔): 2026 年的新興技術,由網路大廠 Arista 帶頭搞出的「超級巨無霸隨身碟」。既然面板塞不下,就做一個超大、密度是現在四倍、甚至自帶「水冷散熱板」的模組。它保留了外接派好維修的優點,同時解決了散熱危機。

LPO 和 LRO 是兩種「線性處理方式」(DSP 拔掉的程度不同,LRO 更務實且目前量產領先),而 XPO 則是全新的「超大外殼規格」,它可以把 LPO 或 LRO 裝進去,讓面板密度直接翻 4 倍。

2. 內建派:原本設計主攻 Scale-up(機櫃內極短距離),但 2026 年已率先在 Scale-out 交換器上量產。

這派認為電訊號走到機殼外面太耗電,因此將翻譯官搬進內部緊貼核心晶片。(GPU 或交換器 ASIC)。

NPO(近封裝光學): 2026 年真正的中間點。它把光引擎放在緊貼晶片的旁邊(距離僅幾毫米),但沒有焊死,而是做成「插槽式」。享受了極致省電的好處,壞了還能單獨拔下來換。

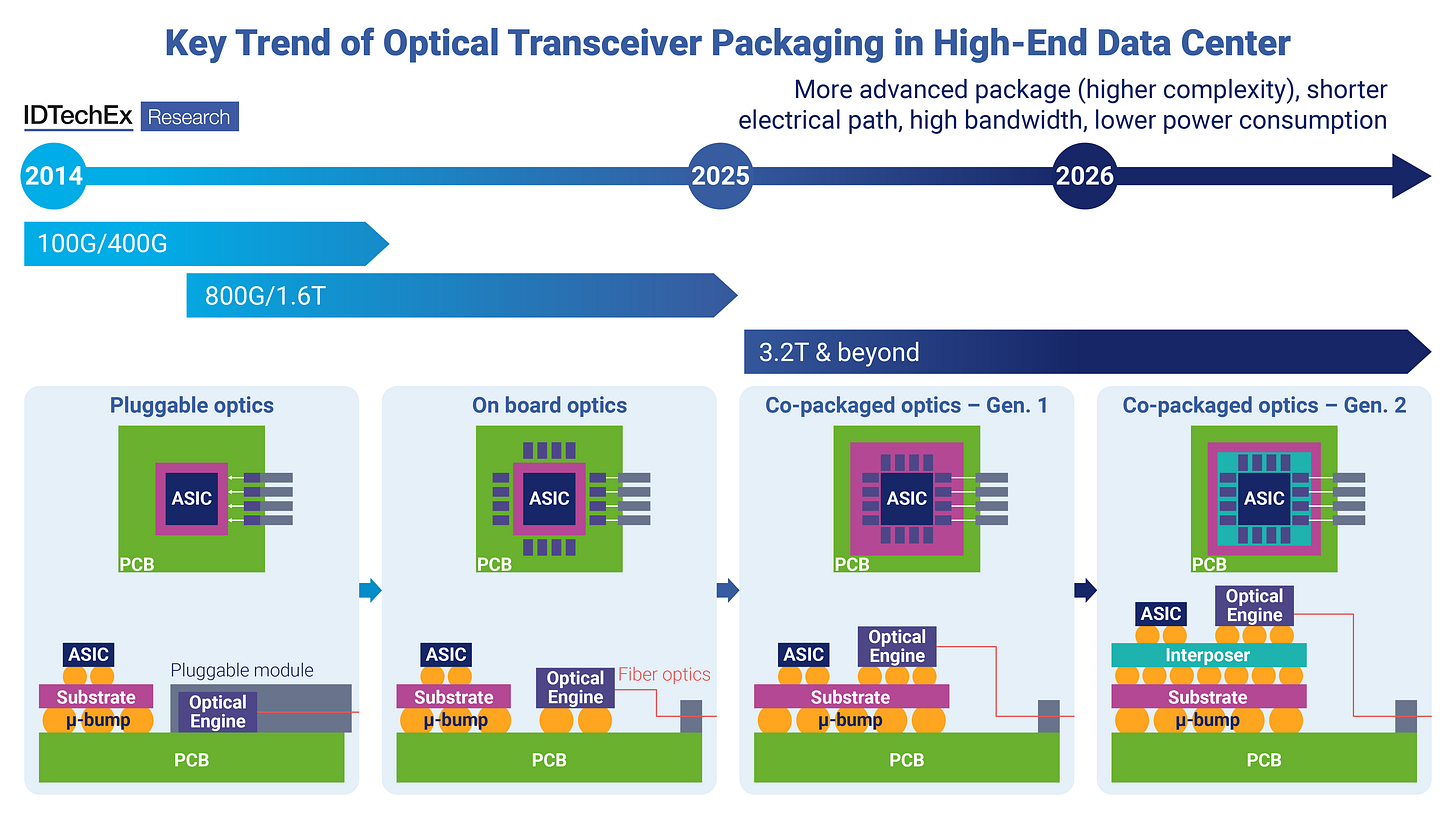

CPO(共封裝光學): 未來的終極武器。 直接把光引擎跟運算晶片包在同一個殼子裡,合而為一。省電無敵、速度最快。目前 NVIDIA 已開始在交換器(Scale-out)上實質出貨 CPO 版本(Spectrum-X / Quantum-X),但在 Scale-up 機櫃內部仍因維修半徑問題而保守使用,因為目前有一個致命傷:維修。只要一個小雷射壞了,整張昂貴的晶片可能都要跟著報廢。

銅線的最後防線:極短距離

在機櫃內部幾十公分到幾公尺的極短距離內,銅線依然有著「零光電轉換功耗」與「超低成本」的絕對優勢。

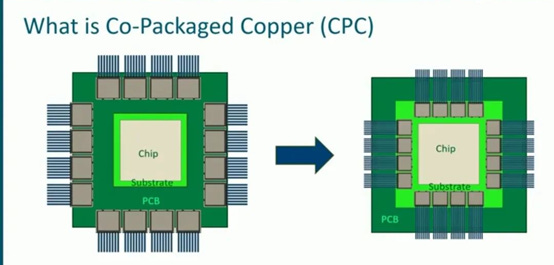

CPC(共封裝銅纜, Co Packaged Copper): 處理晶片到晶片的超短距離(<1.5 公尺),直接從晶片拉出超粗銅線。這是 NPO/CPO 在機櫃內部最直接的對手,目前由 Samtec、TE Connectivity 與 Marvell 主推,是 Scale-up 極短連線的最後銅線堡壘。

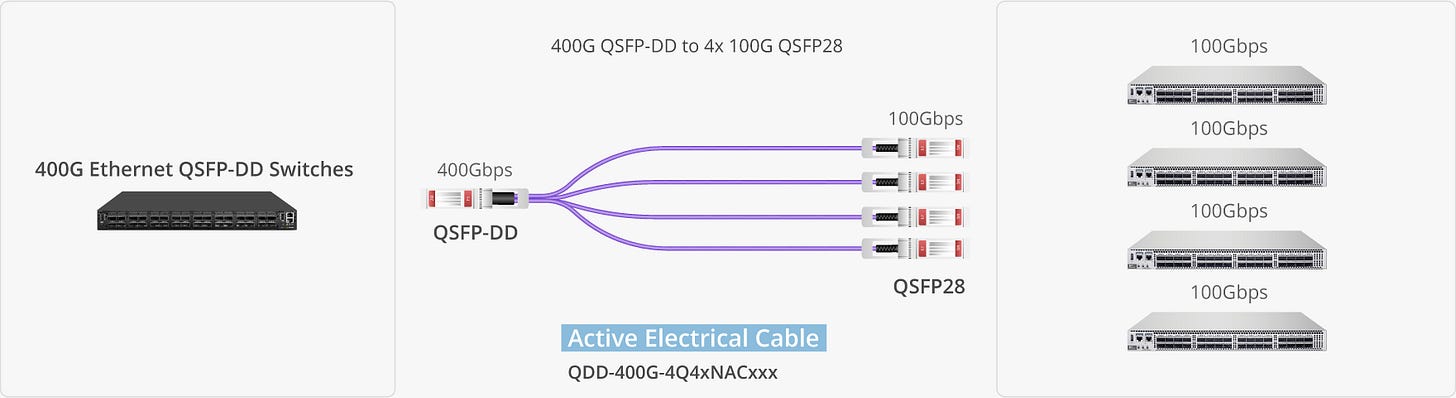

AEC(主動電纜, Active Electrical Cables): 處理交換器到交換器的中短距離(2–7 公尺,這是 Credo 等公司的強項)。這是 LPO/LRO/XPO 在 Scale-out 短連線的最直接競爭者。Credo 目前市占領先,已被 AWS、Microsoft、Meta 大量採用。

CPC 與 AEC 本身並非競爭關係,而是各司其職(一個超短、一個中短)。它們共同組成銅線在 AI 機房裡的「最後防線」,只要距離夠短、成本與可靠性優先,銅線就還不會被光學完全取代。

雖然外接派主要對應 Scale-out、內建派主要對應 Scale-up,但這只是方便記憶的「戰場分工」。實際部署時,超級大廠會根據具體距離、功耗與維修需求混合使用(例如CPO/NPO也開始用在Scale-out場景)。

核心共識:這不是一場「你死我活」的淘汰賽

OFC 2026 給投資人與產業觀察者最重要的一個觀念是:不要再問「誰會取代誰」了。

在未來的 AI 算力中心裡,這些技術將會「混合部署」、各司其職。一台頂級的交換器,它的前面板可能插著 XPO(負責向外連線 Scale-out),機器內部裝著 NPO(負責極速省電的轉換),而機櫃內最近的兩顆 GPU 之間,依然連著 CPC 銅線。

這是一張百花齊放的藍圖。而為了讓這些千奇百怪的武器能夠互相配合,廠商們在 OFC 開展前夕,聯手制定了三個全新的遊戲規則。

第一章小結:兩個座標軸

地理範圍三維度:Scale-up(機櫃內GPU互連)、Scale-out(機櫃間連線)、Scale-across(跨城市DCI)

光電轉換技術分類:外接派(LPO/LRO/XPO)vs 內建派(NPO/CPO)vs 銅線(CPC/AEC)

核心共識:未來是混合部署,非單一技術淘汰賽

第二章:OFC 2026 最大的新聞——三套新標準同時落地

在 OFC 大會開幕的前後幾天,光通訊產業同時發布了三套全新的產業標準(MSA,多源協議)。

這三套標準各自針對 AI 資料中心光通訊的不同環節,提供統一規範:

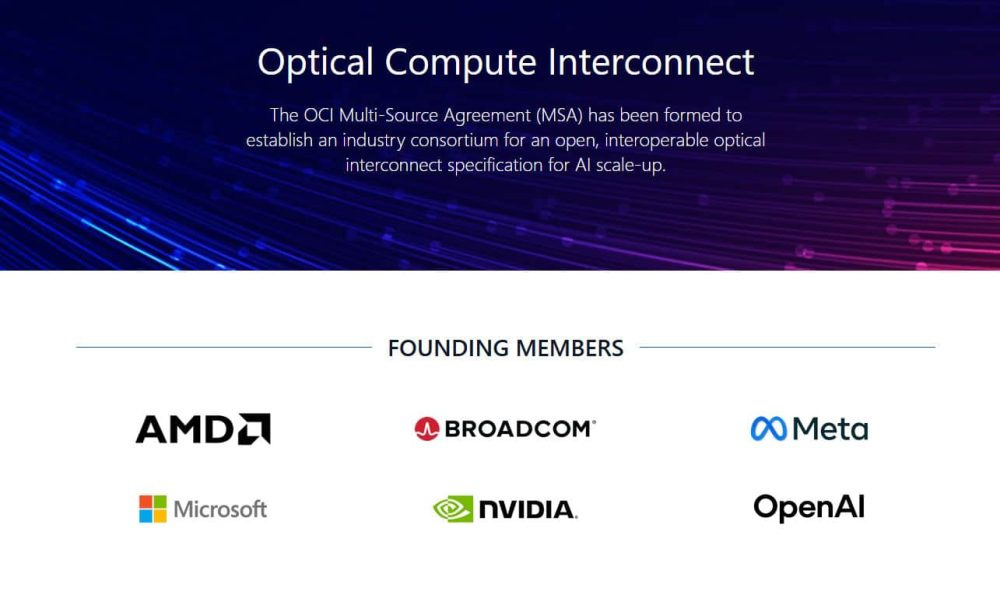

OCI MSA: 定義了 Scale-up(機櫃內部、GPU 之間極短距離互連)所使用的光訊號格式與傳輸協定。它讓所有設備都能用同一套共同語言來傳輸資料,取代過去已經逼近物理極限的銅線方案。

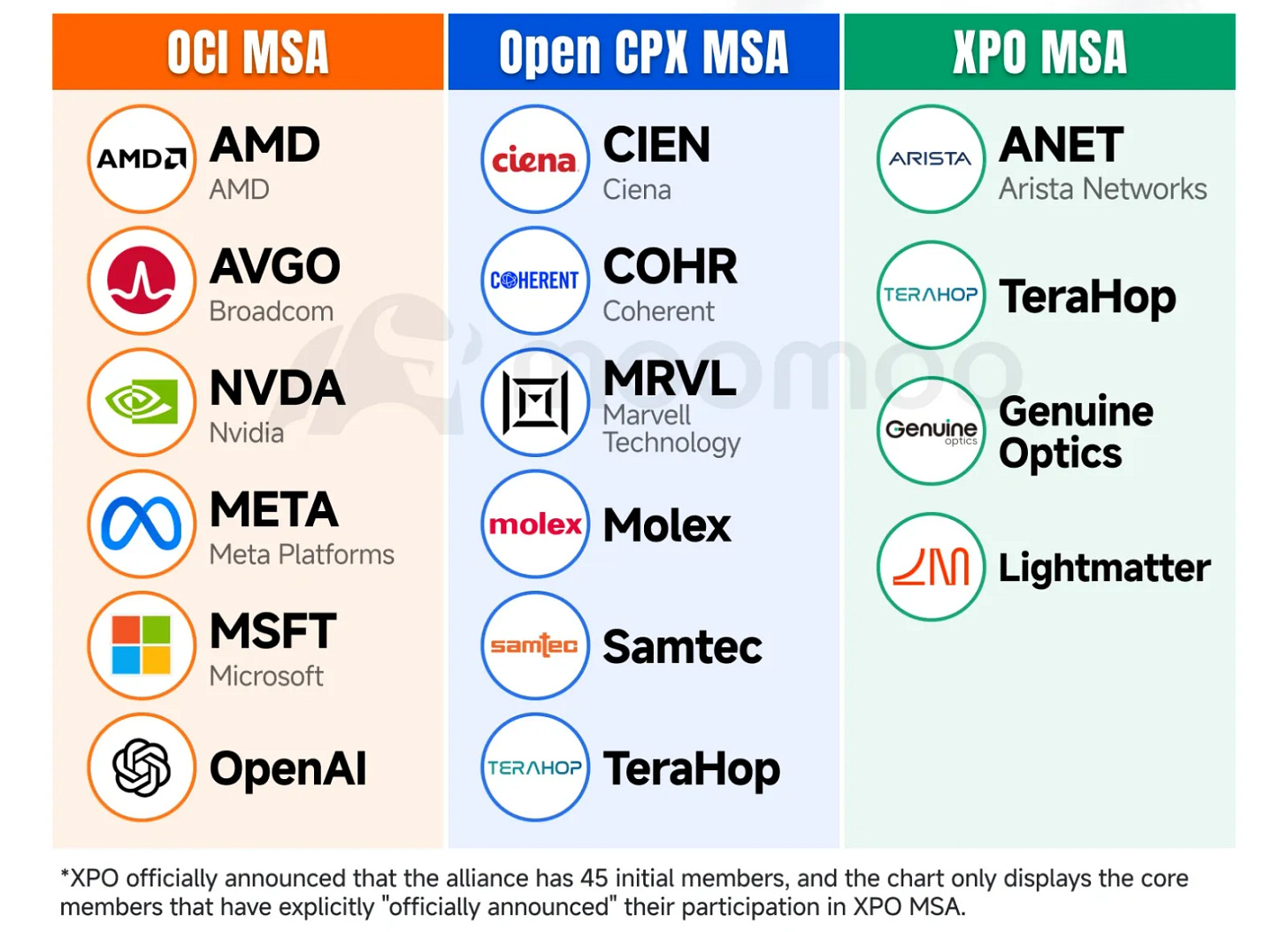

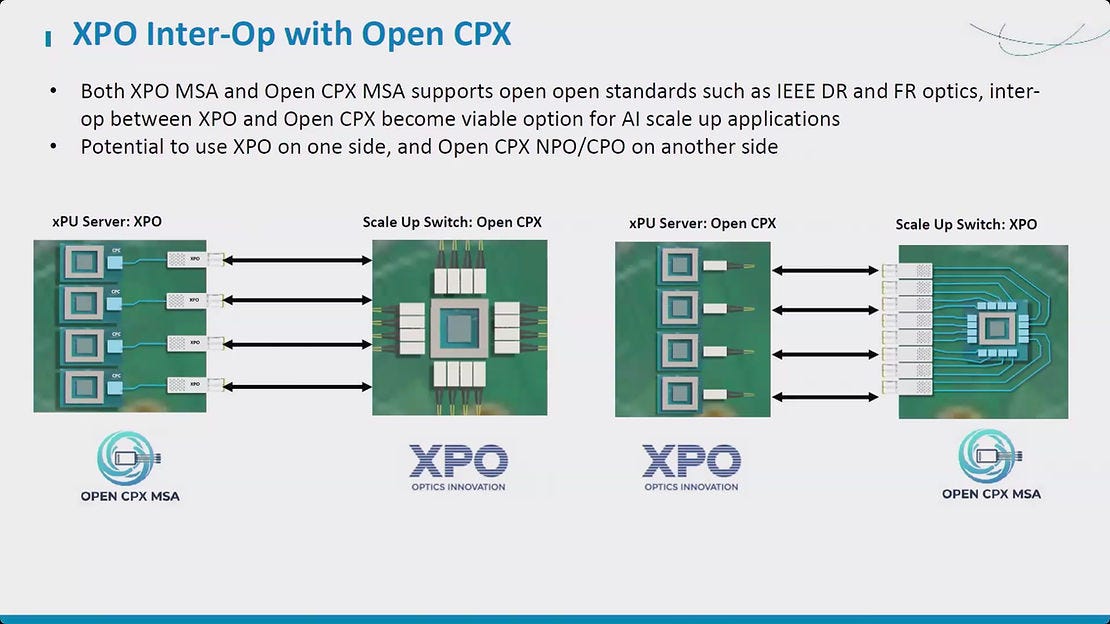

XPO MSA: 定義了 外接式大型光模組 的外殼、散熱設計與機械規格。它專為 Scale-out(機櫃之間的連線)設計,大幅提高前面板的模組密度與散熱能力,讓單一模組就能處理更高頻寬。

Open CPX MSA: 定義了 光學引擎直接安裝在晶片旁邊 的插座與介面規格。它讓 NPO 或 CPO 等內建式光學技術能跨廠商互換使用,解決了過去每家規格都不相容的問題。

當這三者結合在一起,產業正式告別了過去幾年「各家廠商各自為政、規格互不相容」的混亂摸索期,進入了可以大規模量產的加速階段。

(一)OCI MSA:超級大廠親自下場制定的「光語言」

如果你攤開 OCI MSA(Optical Compute Interconnect) 的發起人名單,你會發現一件有趣的事:AMD、Broadcom、Meta、Microsoft、NVIDIA、OpenAI。

發現了嗎?這份名單裡,沒有任何一家傳統的光學零組件大廠(例如 Coherent 或 Lumentum)。這是一份純粹由「買方」與「晶片設計方」組成的超級聯盟。這是歷史上第一次,超級大廠們決定繞過光學供應商,直接站出來定義光學規格。

他們要解決什麼問題?

OCI 的唯一目標,是為 Scale-up 制定開放標準,取代逼近極限的銅線。

在技術上,OCI 選擇了一條「化繁為簡」的務實路線。它放棄了複雜且耗電的 DSP 訊號處理,改用最基礎的 NRZ 調變技術。

為了達到極高頻寬,它採用了 DWDM(密集波分複用) 技術,讓單一根標準光纖可以同時跑多種顏色的光,而且是「雙向傳輸(BiDi)」。

第一代(GEN1)標準 就能在單根光纖上達成單向 200Gbps 的速度,第二代將翻倍至 800Gbps,未來的路線圖更直指 3.2Tbps 以上。

OCI 架構預設採用 「外部雷射源(ELS)」設計,這是其核心規範之一。因為雷射發光時非常怕熱,而 GPU 旁邊又是一個大火爐,把雷射移到外面,不僅解決了散熱問題,雷射壞了也更容易更換。

這套標準的誕生,本質上是超級大廠們為了「削弱單一供應商議價能力」的策略。

過去,如果你買了某家的光學引擎,你就被他的專利綁死了;現在,只要大家都說 OCI 這套「統一語言」,微軟或 Meta 就可以自由混搭不同供應商的零件。

這對 Coherent 或 Lumentum 這些光學軍火商是壞事嗎?短期來看,他們的議價能力確實被稀釋了;但從大局來看,因為 OCI 標準化了規格,整個 Scale-up 光通訊市場 將從「零」開始迎來爆發性成長。

把餅做大的速度,絕對遠超過毛利被壓縮的速度,因此對光學大廠依然是淨利多。

(註:你可能注意到了,這份超級大廠名單裡少了一個關鍵名字:Google。他們為什麼不加入?我們將在後面的章節為您揭曉。)

(二)XPO MSA:Arista 主導的「超級大插頭」

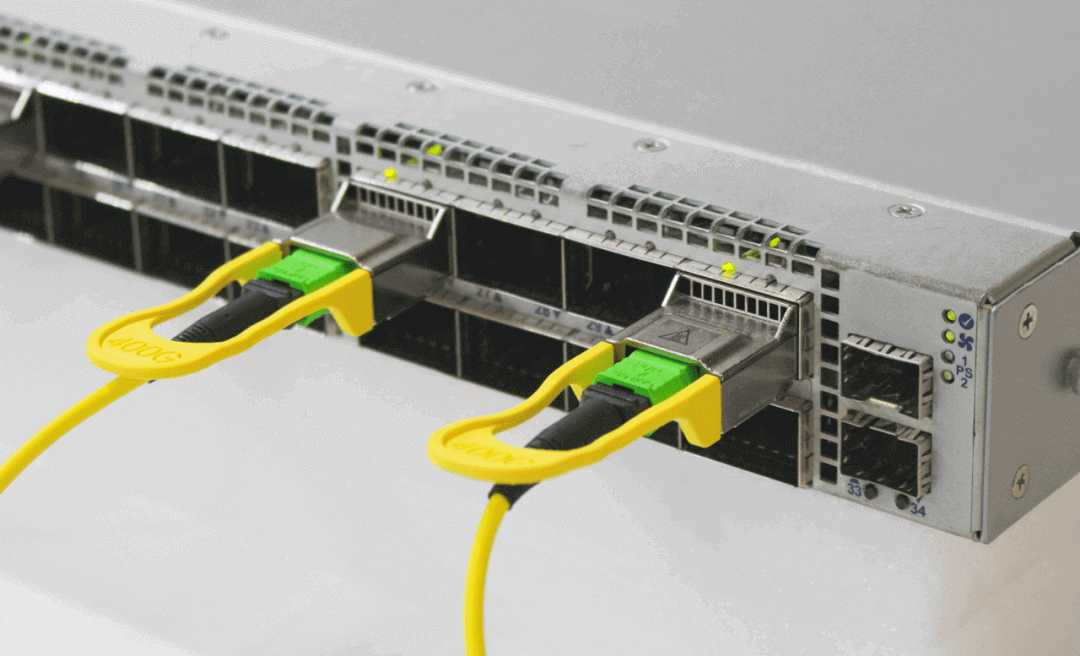

如果說 OCI 是看不見的訊號語言,那麼由 Arista 領軍、聯手超過 45 家廠商 在 2026 年 OFC 展會推出的 XPO (eXtra-dense Pluggable Optics),就是肉眼可見的硬體進化。

這項技術出現的核心動機非常簡單:當 AI 叢集的規模衝到 10 萬顆 GPU 以上,傳統的網路連接方式已經無法支撐「Scale-out」所需的極致密度。

在 XPO 出現之前,業界主要依賴 OSFP 模組,外型就像一個寬大的 USB 隨身碟,插在交換器的前面板上。

然而,隨著傳輸速度狂飆,這些「小隨身碟」遇到了兩大物理障礙。首先是散熱,單一模組產生的廢熱已突破 400W,熱得像熨斗一樣,傳統的風扇空冷幾乎快要把機房融化;其次是頻寬,前面板的空間有限,無法塞進更多插頭來滿足日益增長的數據胃口。

Arista 的解法十分直接:既然現有的插頭不夠用,那就做一個「自帶水冷的超級大插頭」。

XPO 的體積 大約是傳統 OSFP 的 2.7 倍,這讓它有空間塞進雙面電路板,使單一模組的頻寬達到驚人的 12.8Tbps,相當於一口氣抵掉 8 個傳統模組。

更關鍵的設計在於它解決了散熱的頑疾。XPO 內部整合了液冷散熱板,透過盲插快拆接頭,利用 40-45°C 的溫水就能輕鬆帶走高達 400W 的熱能。此外,為了應對如此龐大的功耗,它改採 50V DC 母線供電,大幅減輕了交換器主機板的電流負擔。

這項轉變對資本支出(CapEx)的影響是顯而易見的。根據 Arista 的試算,在一座擁有 12.8 萬顆 GPU 的超級 AI 工廠中,如果使用傳統模組,需要建構 1,408 個交換器機架;但如果改用密度高出四倍的 XPO,機架數量能精簡至 352 個。這省下的不僅是昂貴的機器設備,還包括龐大的機房空間、複雜的管線佈置與冷卻電費。

值得注意的是,這項技術之所以獲得微軟等巨頭的支持,是因為它完美保留了「外接派」的核心優勢:可維修性。

與那些將光學組件直接焊死在晶片旁的內部技術(如 CPO)不同,XPO 維持了機械式卡榫設計。

一旦模組發生故障,技術人員只需要像拔 USB 一樣將其拉出更換,完全不需要讓整台交換器停機。在追求算力極致的同時,XPO 為資料中心保留了那份極其珍貴的營運韌性與彈性。

Arista 本身並不製造或銷售 XPO 光學模組,這些模組將由 MSA 合作的光學供應商(包含所有主要廠商)生產與出貨,他們的核心業務仍是銷售高速乙太網路交換器與完整網路系統。

XPO 的重點在於間接但高槓桿的營收加速:它讓 Arista 的交換器解決方案變得極具吸引力,帶動 Arista 核心交換器與系統的出貨量。

(三)Open CPX MSA:為 CPO/NPO 打造的「通用插座」

最後一塊拼圖,是為「內建派」準備的 Open CPX MSA。由 Ciena、Coherent、Marvell 等大廠發起。

如果光學引擎要搬進機器內部,緊貼著核心晶片(這就是我們前面說的 NPO 或 CPO),目前最大的障礙就是「每家廠商的長相都不一樣」。A 廠的腳位跟 B 廠的散熱設計完全不相容。

Open CPX 的目標,就是把這些靠近晶片的光學引擎,變成可以跨品牌互換的「標準化插座模組」。他們正在定義統一的連接器機械結構、散熱供電方式以及電氣腳位。

你可以把它想像成光通訊界的「USB-C 接口統一運動」,預計在五年內,這種標準化插座每年的出貨量將超過一億個端口。

三者如何完美協同?

看到這裡,你應該明白了:這三套標準完全沒有競爭關係。

在未來的 AI 伺服器裡,你可以讓光訊號跑著 OCI 標準 的語言,然後根據你的需求,選擇把它裝進 XPO 模組(插在機器外面,方便維修、密度極高),或者是把它裝進 Open CPX 引擎(裝在機器內部晶片旁,追求極致省電)。

這三套標準的同時落地,是 OFC 2026 釋放出最強烈的結構性訊號:產業的「去風險化(De-risk)」已經完成。

超級大廠們不再需要把幾百億美元的預算押注在單一廠商的獨家技術上。供應鏈變得可預測、多元化且標準化。 當遊戲規則畫定,接下來就是產能與良率的軍備競賽了。

第二章小結:三套新標準落地

OCI MSA:由買方主導(NVIDIA/微軟/Meta等),定義Scale-up光訊號標準,削弱供應商議價能力

XPO MSA:Arista主導,超大外殼+水冷散熱,面板密度翻4倍,保留可維修性

Open CPX MSA:為NPO/CPO打造通用插座,解決跨廠商相容問題

意義:產業告別混亂摸索期,進入大規模量產加速階段

第三章:CPO 準備好了嗎?

在 OFC 2026 中,有一場名為「CPO 整合是否已為 AI 管線準備就緒?」的論壇,由 NVIDIA、Broadcom 等技術先驅主持,坐著來自 Google、Meta、Oracle 與微軟 的頂尖專家。

被譽為終極武器的 CPO(共封裝光學),究竟是否已經準備就緒?這場大會直接把 CPO 的四大問題 攤在了陽光下。

問題一:維修問題

這是全場討論最激烈、也是超級大廠們最害怕的問題。

想像一下,你家客廳的一顆燈泡壞了,但因為這顆燈泡是跟整棟房子的地基「焊死」在一起的,所以為了換燈泡,你必須把整棟房子拆了。這就是目前 CPO 面臨的窘境。

在傳統設計裡,光模組壞了,工程師只要走到機櫃前,像拔隨身碟一樣把它拔出來換一顆就好。

但在 CPO 的架構 下,光學引擎是跟極度昂貴的交換器核心晶片綁在一起的。只要其中一個光學通道故障,可能連帶導致 64 個以上的端口 停擺,甚至整張價值數萬美元的主板都要跟著報廢。

來自 Google 與 Meta 的專家帶來了真實的營運數據,坦言他們對 CPO 感到「猶豫」。

Meta 曾在部份交換器上做過實機測試,結論是:「看起來有希望,但樣本量遠遠不足以說服我們把身家押上去。」 Oracle 的架構師亦表示,在千兆瓦級的 AI 工廠裡,機器的「營運韌性」是絕對不容妥協的。

問題二:從無塵室到機房的「水土不服」

即便解決了維修問題,CPO 在製造與物理環境上也面臨巨大挑戰。

專家們點出了一個現實:CPO 需要將光纖與晶片進行極度精準的對齊。 在實驗室的無塵室裡,這件事可以做得很完美;但當這些設備被搬進充滿微塵、震動、且溫度極高的實際機房時,只要有一點點灰塵掉進去,或者底板因為高溫產生了微小的翹曲,光訊號就會嚴重衰減。

此外,CPO 把光學元件拉到了發熱量極大的運算晶片旁邊,這意味著它必須承受比以往更高的溫度,散熱管理變得異常複雜,幾乎非得依賴水冷不可。

問題三:成本與功耗的痛苦抉擇

Keep reading with a 7-day free trial

Subscribe to FOMO研究院電子報 to keep reading this post and get 7 days of free access to the full post archives.

![Data Center Cleaning Best Practices for 2023 [2023] - C&C Technology Group Data Center Cleaning Best Practices for 2023 [2023] - C&C Technology Group](https://substackcdn.com/image/fetch/$s_!Orin!,w_1456,c_limit,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2Fd46d0004-b3b2-47ca-9565-89d7935a3022_1080x608.jpeg)